株式会社ELYZAについてですが、推定社員数は1~10人になります。所在地は文京区本郷3丁目15番9号になり、株式会社A&Tリアライズが近くにあります。法人番号について「2010001194697」になります。 株式会社ELYZAの訪問時の会話キッカケ

株式会社ELYZAに行くときに、お時間があれば「東洋文庫ミュージアム」に立ち寄るのもいいかもしれません。

「

こんな素敵な日にお会いできて嬉しいです。

東洋文庫ミュージアムが近くにあるようですが、どんな展示物があるか、ご存知ですか

株式会社ELYZAへの通勤は電車通勤ですか

」

google map

2025年06月05月 13時

アルティウスリンク、ELYZA、「コンタクトリーズン分類LLMアプリ」を

2025年05月22月 11時

ELYZA、論理的思考能力を強化した「Reasoning Model」を

2025年05月01月 13時

ELYZA、「GPT-4」を上回る性能の日本語LLMを開発・公開

2024年06月26月 14時

NEDOが公募した「競争力ある生成AI基盤モデルの開発(助成)」にELY

2024年05月17月 15時

大規模言語モデル(LLM)の社会実装を進める株式会社ELYZA(代表取締役:曽根岡侑也、以下ELYZA)は、デジタル庁の「生成AIの業務利用に関する技術検証および利用環境整備」を受託※ し、2024年5月31日から2025年3月31日までの期間、支援を行ったことを公表いたします。

※

https://nsearch.jp/nyusatsu_ankens/65e6e99a67874f41f7ed4d6b

受託概要

名称

生成AIの業務利用に関する技術検証および利用環境整備

期間

2024年5月31日 ~ 2025年3月31日

目的

「我が国の行政組織における生成AIの業務活用を進めるために、生成AIを行政組織において業務活用を行うにあたっての課題を洗い出し、対応策を示すこと」への支援

支援内容

生成AIアプリの作成・業務利用が可能な独自の『法人向け生成AI活用SaaS』の提供

支援内容の全体像

図:支援内容の全体像

『法人向け生成AI活用SaaS』の概要

本プロジェクトで活用されたELYZA独自の『法人向け生成AI活用SaaS』の概要は以下の通りです。

•

重要業務で組織的にLLMを導入するためのボトルネックを解消し、いち早い実用化を叶えるサービス

•

日系大手金融機関等のセキュリティ審査基準をクリアして導入された実績あり

•

導入後の利用・定着を見据えたUXを具備

•

海外製モデル、および独自開発LLMの双方を安定的に運用が可能

•

安心安全に管理する機能、使う機能を標準で搭載

•

柔軟なUI設計が可能、利用者からのフィードバック回収も可能

なお、『法人向け生成AI活用SaaS』は、2025年度に法人向けに販売開始を予定しています。詳細情報については順次発表いたしますので、ご期待ください。

会社概要

株式会社ELYZAは、「未踏の領域で、あたりまえを創る」という理念のもと、日本語の大規模言語モデルに焦点を当て、企業との共同研究やクラウドサービスの開発を行なっております。先端技術の研究開発とコンサルティングによって、企業成長に貢献する形で大規模言語モデルの導入実装を推進します。

<会社概要>

社名 :株式会社ELYZA

所在地 :〒113-0033 東京都文京区本郷3-15-9 SWTビル 6F

代表者 :代表取締役 曽根岡侑也

設立 :2018年9月

URL :

https://elyza.ai/

「Altius ONE for Support」の標準機能に搭載し、提供開始

アルティウスリンク、ELYZAは、生成AI技術を活用し、コンタクトセンターのデータ活用を効率化・高度化する「コンタクトリーズン分類LLMアプリ」を開発、2025年5月22日からアルティウスリンク提供のコンタクトセンター向けサービス「Altius ONE for

Support」※1の標準機能として提供を開始します。両社は、2024年より業界特化型のLLMアプリ開発を進めており※2、本アプリは、アルティウスリンクが運営を支援し、月間約200万件のお問合せに対応する「KDDIお客さまセンター」のコンタクトリーズン(お客さまが問い合わせる理由・お困りごと)データを基に実証実験を実施し、開発したものです※3。 対話・メール要約、メール回答草案生成に続く、3つ目のLLMを用いた国内製のコンタクトセンター領域の業務支援アプリとなり、業界では希少なサービスの開発・提供となります※4。

「Altius ONE for Support」標準機能のLLMアプリラインナップ

コンタクトセンターでは、日々多くのお客さまからのお問い合わせ内容やご意見、ご要望など、さまざまな情報が蓄積されています。その中でも、「応対履歴」はお客さまの生の声を反映した貴重な情報源であり、商品・サービスに対するご要望や潜在ニーズに至るまで、顧客インサイトが把握できることから、データの活用が注目されています。しかし効果的に活用するためには、データの「変換」や「加工」などの前処理に多大な労力がかかるため、多くの企業では活用が進んでいないのが現状です。

「コンタクトリーズン分類LLMアプリ」は、「応対履歴」を活用するためのデータの前処理を自動化することで、分析用データ整備の工数を大幅に削減かつ高い精度で行うことが可能です。音声認識システムでテキスト化された応対履歴を基に、「本人確認の有無」「対象商品」「問合せ内容」「回答内容」「コンタクトリーズン」などの構造化データに変換します。そのデータから同種類のコンタクトリーズンをまとめて、さらに分類し、分析しやすいデータに整えます。「KDDIお客さまセンター」における実証実験では高い精度の分類結果となり、アプリの有効性を確認しています。

アルティウスリンクは、国内最大規模のコンタクトセンター運営ノウハウを生かし、「コンタクトリーズン分類LLMアプリ」で整えたデータを基に分析を行い、優先度の高いカテゴリーの顧客対応を強化するといった戦略立案を提供します。具体的にはFAQの最適化、IVR(自動音声応答)やチャットボットの導入検討などチャネル設計の最適化、トークスクリプトやオペレーターの教育研修の見直しを支援し、より快適なCXをデザインします。また、商品・サービス改善などのマーケティングにも活用いただくことで、経営のスピーディーな意思決定を支援し、お客様企業のBX(ビジネストランスフォーメーション)に貢献します。

ELYZAは、本アプリにとどまらず、コンタクトセンター領域における生成AIを活用した業務支援アプリの開発を継続し、順次提供に向けて準備を進めてまいります。

「コンタクトリーズン分類LLMアプリ」活用イメージ

「コンタクトリーズン分類LLMアプリ」分類結果イメージ

今後もお客様企業からのフィードバックをもとにLLMアプリの改善・開発を進め、アルティウスリンクにおけるコンタクトセンター運営サービスの品質強化や、競争力向上のための価値創出を実現してまいります。

※1.デジタルBPOを推進する新サービスブランド「Altius ONE」リリース

https://www.altius-link.com/news/detail20240508.html

※2.KDDI、アルティウスリンク、ELYZA、コンタクトセンター特化型LLMアプリを開発

https://www.altius-link.com/news/detail20240903.html

※3. KDDIとアルティウスリンク、カスタマーサポート領域の新事業プロジェクトを開始

https://www.altius-link.com/news/detail20241111.html

※4.国産LLMアプリを開発している企業・業界を対象とする

ELYZA会社概要

株式会社ELYZAは、「未踏の領域で、あたりまえを創る」という理念のもと、日本語の大規模言語モデルに焦点を当て、企業との共同研究やクラウドサービスの開発を行なっております。先端技術の研究開発とコンサルティングによって、企業成長に貢献する形で大規模言語モデルの導入実装を推進します。

<会社概要>

社名 :株式会社ELYZA

所在地 :〒113-0033 東京都文京区本郷3-15-9 SWTビル 6F

代表者 :代表取締役 曽根岡侑也

設立 :2018年9月

URL :

https://elyza.ai/

本リリース本文中の製品名および会社名等は、各社の商標または登録商標です。

「o1-mini」に匹敵する性能を達成。開発過程で得られた「Shortcut Model」も併せて公開

大規模言語モデル(LLM)の社会実装を進める株式会社ELYZA(代表取締役:曽根岡侑也、以下ELYZA)は、日本語における論理的思考能力を強化したLLMである「ELYZA-Thinking-1.0-Qwen-32B」を開発し、商用利用可能な形で一般公開しました。同モデルはOpenAI社の「o1/o3」シリーズや、DeepSeek社の「DeepSeek-R1」と同様に、思考の連鎖 (Chain of Thought; CoT) を通して複雑な論理的思考を行う能力を強化した「Reasoning Model」です。また、今回の開発過程で得られた「Shortcut Model」も併せて公開しています。

各モデルは Apache 2.0 ライセンスで公開され、研究・営利目的での利用が可能です。

Reasoning Model:

ELYZA-Thinking-1.0-Qwen-32B

Shortcut Model:

ELYZA-Shortcut-1.0-Qwen-32B

/

ELYZA-Shortcut-1.0-Qwen-7B

各モデルの開発プロセスや技術的な詳細、各種ベンチマークの解説を含む評価の詳細情報は、公式テックブログにて解説しています。こちらも是非ご覧ください。

ELYZA-Thinking-1.0: MCTS を用いた推論パス探索と模倣学習による Large Reasoning Model の開発

ELYZAでは引き続き、AIエージェント等を含む最先端の研究開発に取り組んでいくとともに、その研究成果を可能な限り公開・提供することを通じて、国内におけるLLMの社会実装の推進、並びに自然言語処理技術の発展を支援してまいります。

「ELYZA-Thinking-1.0-Qwen-32B」の概要

「ELYZA-Thinking-1.0-Qwen-32B」は、アリババ社が公開している「非 Reasoning Model」である「Qwen2.5-32B-Instruct」に対して、日本語追加事前学習と長い思考過程を伴うデータによる Supervised Fine Tuning (SFT) を実行することで、日本語における論理的思考能力を向上させたモデルです。

同モデルは、320 億パラメータと比較的軽量なモデルでありながら、同じ「Reasoning Model」であるOpenAI社の「o1-mini」に匹敵する性能を達成しました。特に、数学系のベンチマークにおいて高い性能を示しており、日英両方で「o1-mini」を上回るスコアを達成しています。

本取り組みの特徴は、既に高度な論理的思考能力を備えた「Reasoning Model」に対して日本語追加学習を行うのではなく、「非 Reasoning Model」に対して新たにその能力を付与した点にあります。

具体的には、プロ棋士を破り話題となったAlphaGo (アルファ碁) でも使用されているMCTS (モンテカルロ木探索)に着想を得たアルゴリズムにより、思考過程を伴う学習データの探索的生成を行い、模倣学習を行いました。

図1:「ELYZA-Thinking-1.0-Qwen-32B」と「o1-mini」の性能比較

「ELYZA-Shortcut-1.0-Qwen-32B/7B」の概要

「ELYZA-Shortcut-1.0-Qwen-32B/7B」は、「Reasoning Model」が深く思考して辿り着いた回答を、反射的に答えられるよう暗記したモデルです。

具体的には、「Reasoning Model」の学習用に探索された多数の (問題、思考過程、回答) セットから思考過程を取り除いた (問題、解答) ペアを使用して SFT を行うことで開発されました。

このモデルを、「Reasoning Model」の思考過程をショートカットして回答を返すように訓練されたモデルという意図を込めて、「Shortcut Model」と呼ぶことにしました。

「Shortcut Model」については、320 億パラメータのモデルと 70 億パラメータのモデルの 2 種類を開発し、公開しました。

以下は、320億パラメータの「Shortcut Model」の性能です。同モデルは、320億パラメータと軽量ながら、同じ「非 Reasoning Model」で商用のAPIが展開されているOpenAI社の「GPT-4o」に匹敵する性能を達成しました。また、登場時にはその性能の高さから多大なインパクトを与え、長らくLLMの性能の目標とされてきた「GPT-4」に対しては、JHumanEval以外の全てのベンチマークで上回る結果となっています。

図2:「ELYZA-Shortcut-1.0-Qwen-32B」と「GPT-4o/4」の性能比較

さらに小型の「ELYZA-Shortcut-1.0-Qwen-7B」の性能については、公式テックブログからご覧ください。また、各モデルの開発プロセスや技術的な詳細、各種ベンチマークの解説を含む評価の詳細情報についても公式テックブログにて解説しています。

ELYZA-Thinking-1.0: MCTS を用いた推論パス探索と模倣学習による Large Reasoning Model の開発

付記および今後の展望

ELYZAは「ELYZA-japanese-Llama-2-7b」から継続してオープンなモデルをベースとした日本語LLMの構築に取り組み、今回の「ELYZA-Thinking-1.0-Qwen-32B」では、論理的思考能力を付与するかたちでの「Reasoning Model」の開発にはじめて成功しました。

今後も、AIエージェント等を含む最先端の研究開発に取り組んでいくとともに、その研究成果を可能な限り公開・提供することを通じて、国内におけるLLMの社会実装の推進、並びに自然言語処理技術の発展を支援してまいります。

ELYZA会社概要

株式会社ELYZAは、「未踏の領域で、あたりまえを創る」という理念のもと、日本語の大規模言語モデルに焦点を当て、企業との共同研究やクラウドサービスの開発を行なっております。先端技術の研究開発とコンサルティングによって、企業成長に貢献する形で大規模言語モデルの導入実装を推進します。

<会社概要>

社名 :株式会社ELYZA

所在地 :〒113-0033 東京都文京区本郷3-15-9 SWTビル 6F

代表者 :代表取締役 曽根岡侑也

設立 :2018年9月

URL :

https://elyza.ai/

「Llama-3-ELYZA-JP-70B」は、チャット形式のデモサイトを用意しております。

ELYZA LLM for JP|デモ版( https://elyza.ai/lp/elyza-llm-for-jp )

※アクセス過多によりリクエストが処理されるまで待ち時間が発生することがあります。

「Llama-3-ELYZA-JP-8B」は、モデル自体を一般公開いたします。LLAMA 3 COMMUNITY LICENSEに準拠しており、Acceptable Use Policyに従う限りにおいては、研究および商業目的での利用が可能です。

Llama-3-ELYZA-JP( https://huggingface.co/collections/elyza/llama-3-elyza-jp-667a311d51c8952e07778ecc )

なお、開発プロセスや評価のより詳細な状況については、note記事で解説しています。こちらも是非ご覧ください。https://note.com/elyza/n/n360b6084fdbd

ELYZAはこれらのモデルの公開・提供を通じて、国内におけるLLMの社会実装の推進、並びにLLMの研究開発の発展を支援してまいります。

■ニュースサマリ

「ELYZA LLM for JP」シリーズの最新モデル「Llama-3-ELYZA-JP」を公開。

70Bモデルは「GPT-4」「Claude 3 Sonnet」などの商用グローバルモデルを上回る性能を実現。チャット形式のデモも用意。高性能な国内製モデルとして、企業向けに提供を予定。

8Bモデルは「GPT-3.5 turbo」を上回る性能を達成し、オープンなモデルのなかでは最高水準の性能を達成。研究および商業目的での利用が可能な形式で一般公開。

ELYZAはモデル公開や提供を通じ、国内におけるLLMの社会実装の推進、並びにLLMの研究開発の発展を支援していく。

■「Llama-3-ELYZA-JP-70B」の概要

「Llama-3-ELYZA-JP-70B」は、Meta社の「Llama-3-70B」をベースに追加の学習(日本語追加事前学習・指示学習)を実施して開発したモデルです。

本モデルは、元の「Llama-3-70B」から大きく日本語性能が向上しており、日本語の性能を測定するための2つのベンチマーク(※1)を用いた自動評価において、国内モデルの中では最高性能の水準を実現し、「GPT-4」や「Claude 3 Sonnet」、「Gemini 1.5 Flash」(※2)と同等あるいは上回る性能を達成しています。

図1:「Llama-3-ELYZA-JP-70B」の性能比較(vs 主要グローバルモデル)

「Llama-3-ELYZA-JP-70B」は、安全なAPIサービスや共同開発プロジェクトなどを通して、様々な形態で、順次企業向けに提供を開始していきます。また、チャット形式のデモサイトを用意しております。

ELYZA LLM for JP|デモ版( https://elyza.ai/lp/elyza-llm-for-jp )

※アクセス過多によりリクエストが処理されるまで待ち時間が発生することがあります。

■「Llama-3-ELYZA-JP-8B」の概要

「Llama-3-ELYZA-JP-8B」は、Meta社の「Llama-3-8B」をベースに事後学習(日本語追加事前学習・指示学習)を実施して開発したモデルです。

「Llama-3-ELYZA-JP-70B」同様、本モデルは、元の「Llama-3-8B」から大きく日本語性能が向上しており、80億パラメータの軽量なモデルでありながら、日本語の性能を測定するための2つのベンチマーク(※1)を用いた自動評価において、「GPT-3.5 Turbo」や「Claude 3 Haiku」、「Gemini 1.0 Pro」(※3)に匹敵する性能を達成しています。

図2:「Llama-3-ELYZA-JP-8B」の性能比較(vs 主要な軽量グローバルモデル)

ELYZAは「Llama-3-ELYZA-JP-8B」について、モデルを一般公開いたします。本モデルはLLAMA 3 COMMUNITY LICENSEに準拠し、Acceptable Use Policyに従う限りにおいて、研究および商業目的での利用が可能です。

Llama-3-ELYZA-JP( https://huggingface.co/collections/elyza/llama-3-elyza-jp-667a311d51c8952e07778ecc )

なお、開発プロセスや評価のより詳細な状況については、note記事で解説しています。こちらも是非ご覧ください。https://note.com/elyza/n/n360b6084fdbd

■「ELYZA LLM for JP」シリーズについて

「ELYZA LLM for JP」は、ELYZAが提供する大規模言語モデル群の総称です。グローバルモデル以外の新たな選択肢として、主にセキュリティやカスタマイズ性を重視する企業、自社サービスや事業にLLMを組み込みたい企業に向けて、安全なAPI サービスや共同開発プロジェクトなど様々な形態で順次提供を開始していきます。

今回公開した「Llama-3-ELYZA-JP-8B」「Llama-3-ELYZA-JP-70B」は、「ELYZA LLM for JP」シリーズの最新モデルとなります。

ELYZA LLM for JP|デモ版( https://elyza.ai/lp/elyza-llm-for-jp )

※アクセス過多によりリクエストが処理されるまで待ち時間が発生することがあります。

■付記および今後の展望

ELYZAは「ELYZA-japanese-Llama-2-7b」から継続して「Llama」シリーズの日本語化に取り組み、今回の「Llama-3-ELYZA-JP」では「GPT-4」や「Claude 3 Sonnet」などを上回る性能を達成することができました。

さらに「Llama」シリーズでの取り組みに限らず、海外のオープンなモデルの日本語化や、独自のLLMの開発に継続して投資をしていきます。これらのモデルの公開・提供を通じて、国内における LLM の社会実装の推進、並びに LLM の研究開発の発展を支援してまいります。

※1 2つのベンチマーク:

1.ELYZA Tasks 100:ELYZAが提供している日本語ベンチマークで、LLM の指示に従う能力や、ユーザーの役に立つ回答を返す能力を測ることを目的としたもの。

2.Japanese MT-Bench:Stability AI 社が提供している日本語ベンチマークで、LLM の対話性能を評価するためのベンチマーク MT-Bench を日本語訳したもの。

※2 「GPT-4」は「gpt-4(0613)」、「Claude 3 Sonnet」は「anthropic.claude-3-sonnet-20240229-v1:0」、「Gemini 1.5 Flash」は2024年6月末時点の最新安定版を指す。

※3 「GPT-3.5 Turbo」は「GPT-3.5 Turbo(0125)」、「Claude 3 Haiku」は「anthropic.claude-3-haiku-20240307-v1:0」、「Gemini 1.0 Pro」は2024年6月末時点の最新安定版を指す。

■ELYZA会社概要

株式会社ELYZAは、「未踏の領域で、あたりまえを創る」という理念のもと、日本語の大規模言語モデルに焦点を当て、企業との共同研究やクラウドサービスの開発を行なっております。先端技術の研究開発とコンサルティングによって、企業成長に貢献する形で大規模言語モデルの導入実装を推進します。

<会社概要>

社名 :株式会社ELYZA

所在地 :〒113-0033 東京都文京区本郷3-15-9 SWTビル 6F

代表者 :代表取締役 曽根岡侑也

設立 :2018年9月

URL :https://elyza.ai/

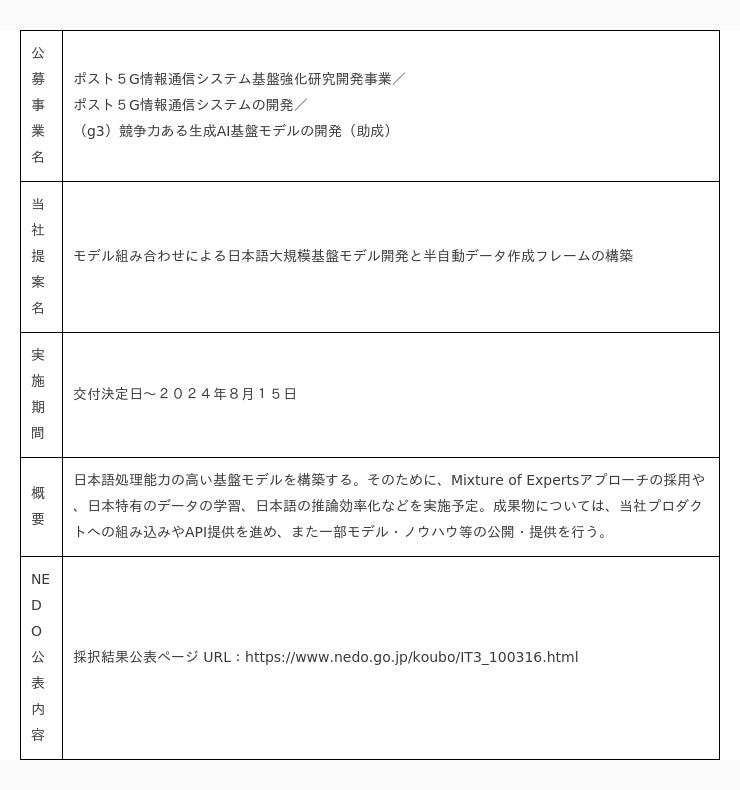

当社では本採択を受け、日本語処理能力の高いモデル構築に取り組んでまいります。モデルの高性能化に加え、日本の知識や表現をより多く学習することに取り組み、インフラとして利用されるような基盤モデルの構築を目指します。弊社は、LLMの研究開発のみならず、社会実装することに注力しており、業務効率化を目的としたLLMを活用したアプリケーション開発やLLMのAPI提供の取り組みを進めております。その活動の中で、本事業で開発した基盤モデルをインフラとして提供することで、国内企業の生産性を大きく向上させることに寄与してまいります。 また、基盤モデル開発の知見をもとに領域特化モデルを開発していくことで、特定の産業における発展や課題解決に繋げてまいります。

■事業概要

■当社の想い

当社は、創業当初の2019年よりLLMの研究開発を開始し、継続的に投資をしております。2024年3月12日には、日本語性能で、GoogleのGemini 1.0 ProやOpenAIのGPT-3.5-turboなどの商用のグローバルモデルに匹敵する精度のLLMを開発し、デモサービスとして公開しました(※2)。また、当社では社会実装にも注力し、LLMの運用基盤や知見を元に、LLMを活用して30~50%の業務効率化を実現した事例を多く生み出しております。

今回のご支援を元に研究開発を推し進め、モデルの高性能化に加えて、日本に適合した基盤モデル、具体的には日本の知識や表現を詳しく学習した基盤モデルの構築を行い、日本で「あたりまえ」に活用されるインフラを目指してまいります。

※1「GENIAC(Generative AI Accelerator Challenge)」は、日本の生成AI の開発力強化を目的とした経済産業省およびNEDOが推進するプロジェクトです。

https://www.meti.go.jp/policy/mono_info_service/geniac/index.html

※2 ELYZA、グローバルモデルに匹敵する日本語LLMを開発、デモ公開

https://prtimes.jp/main/html/rd/p/000000042.000047565.html

■ELYZA会社概要

株式会社ELYZAは、「未踏の領域で、あたりまえを創る」という理念のもと、日本語の大規模言語モデルに焦点を当て、企業との共同研究やクラウドサービスの開発を行なっております。先端技術の研究開発とコンサルティングによって、企業成長に貢献する形で大規模言語モデルの導入実装を推進します。

<会社概要>

社名 :株式会社ELYZA

所在地 :〒113-0033 東京都文京区本郷3-15-9 SWTビル 6F

代表者 :代表取締役 曽根岡侑也

設立 :2018年9月

URL :https://elyza.ai/

株式会社ELYZAの情報

東京都文京区本郷3丁目15番9号

法人名フリガナ

イライザ

住所

〒113-0033 東京都文京区本郷3丁目15番9号

推定社員数

1~10人

地域の企業

地域の観光施設

地域の図書館

法人番号

2010001194697

法人処理区分

国内所在地の変更

法人更新年月日

2021/11/26

プレスリリース

ELYZA、デジタル庁の「生成AIの業務利用に関する技術検証および利用環

ELYZA、デジタル庁の「生成AIの業務利用に関する技術検証および利用環境整備」を受託、プロジェクトを実施

2025年06月05月 13時

ELYZA、デジタル庁の「生成AIの業務利用に関する技術検証および利用環境整備」を受託、プロジェクトを実施

アルティウスリンク、ELYZA、「コンタクトリーズン分類LLMアプリ」を開発

2025年05月22月 11時

アルティウスリンク、ELYZA、「コンタクトリーズン分類LLMアプリ」を開発

ELYZA、論理的思考能力を強化した「Reasoning Model」を開発、商用利用可能な形式で公開

2025年05月01月 13時

ELYZA、論理的思考能力を強化した「Reasoning Model」を開発、商用利用可能な形式で公開

ELYZA、「GPT-4」を上回る性能の日本語LLMを開発・公開

2024年06月26月 14時

オープンモデルをベースに開発、70Bモデルは「GPT-4」超えを達成、軽量な8Bモデルは商用利用可能な形式で一般公開へ 大規模言語モデルの社会実装を進める株式会社ELYZA(代表取締役:曽根岡侑也、以下ELYZA)は、ELYZAが提供する大規模言語モデル「ELYZA LLM for JP」シリーズの最新モデルとして、Meta社の「Llama 3」をベースとした700億パラメータの「Llama-3-ELYZA-JP-70B」と80億パラメータの「Llama-3-ELYZA-JP-8B」を開発し、性能を公開しました。

NEDOが公募した「競争力ある生成AI基盤モデルの開発(助成)」にELYZAの日本語LLM開発事業案が採択

2024年05月17月 15時

計算資源の提供支援を受け、日本語処理能力の高いモデル構築の実施へ 大規模言語モデル(LLM)の社会実装を進める株式会社ELYZA(代表取締役:曽根岡 侑也、以下当社)は、日本の生成AIの開発力強化を目的としたプロジェクト「GENIAC(Generative AI Accelerator Challenge)※1」のもと、国立研究開発法人新エネルギー・産業技術総合開発機構(以下「NEDO」)が公募した「ポスト5G情報通信システム基盤強化研究開発事業/ポスト5G情報通信システムの開発/競争力ある生成AI基盤モデルの開発(助成)」に採択されましたことをお知らせいたします。本プロジェクトでは、計算資源の提供や関係者間の連携促進等の支援をいただきます。